🔄 Update April 2026: Modell-Tabelle komplett aktualisiert (Claude 4.6, GPT-5.3, Gemini 3.1 Pro). Neue Sektion zu MCP-Support, AI Agents und Plugins ergänzt. GPT-4o wurde von OpenAI eingestellt - Tabelle entsprechend angepasst.

TypingMind Projekte: Experten-Guide Chat-Organisation

Als DevOps Engineer habe ich TypingMind Projekte über ein Jahr lang intensiv für meine KI-gestützten Arbeitsabläufe genutzt. In diesem Guide zeige ich dir, wie du die Projektordner-Funktionen für deine Arbeit einsetzen kannst - von der ersten Einrichtung bis zu fortgeschrittenen Techniken wie Dynamic Context mit eigener API.

Das erwartet dich in diesem Guide:

- Was sind TypingMind Projekte und ihre Vorteile

- Neue Features: MCP-Support, AI Agents, Plugins

- Schritt-für-Schritt-Einrichtung von Projekten

- Praxiserprobte Organisationsstrategien

- WordPress-API-Integration als konkretes Beispiel

DarkWolfCave.de

Was sind TypingMind Projekte?

TypingMind Projekte sind die Weiterentwicklung der klassischen Ordner-Funktion. Sie bieten dir einen spezialisierten Arbeitsbereich, in dem du nicht nur deine Chats organisieren, sondern auch projektspezifische Einstellungen zentral verwalten kannst.

Du kannst für jedes Projekt individuelle KI-Modelle festlegen, eigene Anweisungen definieren und relevante Dokumente hinterlegen. Dazu kommt Dynamic Context - du kannst gezielt eine API ansteuern und von dort aktuelle Informationen abrufen. Das macht die Arbeit mit verschiedenen Themen und Aufgaben deutlich effizienter.

Was hat sich seit 2025 geändert?

TypingMind hat sich seitdem stark weiterentwickelt. Die wichtigsten Neuerungen:

- MCP-Support (Model Context Protocol): Du kannst jetzt Remote-Server via Streaming HTTP oder lokale Tools via npx/uvx/Docker einbinden. MCP-Verbindungen erscheinen als Plugins und lassen sich einzeln aktivieren oder deaktivieren.

- AI Agents: Über 60 vorgefertigte Agenten stehen bereit. Du kannst jedem Agenten eigene MCP-Tools und Plugins zuweisen.

- Erweiterte Modell-Unterstützung: Alle aktuellen Modelle von Anthropic, OpenAI, Google und weiteren Anbietern werden unterstützt. Über Custom Endpoints oder OpenRouter lassen sich auch weitere Modelle einbinden.

- Einmalkauf bleibt: TypingMind kostet weiterhin einmalig ab 39 USD. Die API-Kosten zahlst du separat direkt an die Anbieter.

Ein Projekt erstellen und einrichten

Die Einrichtung eines neuen Projekts ist denkbar einfach:

- Öffne in der linken Sidebar den “Chat” in TypingMind

- Klicke auf das ”+” an dem Verzeichnis-Symbol (Neues Projekt/Verzeichnis erstellen)

- Vergib einen aussagekräftigen Namen für dein Projekt

- Speichern und fertig

In den Projekteinstellungen kannst du anschließend:

- Ein spezifisches KI-Modell zuweisen (z.B. Claude Opus 4.6 für kreative Aufgaben, Gemini 2.5 Flash für lange Dokumente usw.)

- Standard-Systeminstruktionen für das Projekt festlegen

- Relevante Dokumente hochladen, die als Kontext dienen sollen

- Auf eine API verweisen, von der du Informationen abrufen möchtest

Projektspezifische Anweisungen

Eine der wichtigsten Funktionen von TypingMind Projekten ist die Möglichkeit, maßgeschneiderte Anweisungen zu definieren. Diese bestimmen, wie die KI - egal ob LLM wie Claude, GPT oder Gemini - in diesem spezifischen Projekt arbeiten soll. Wir kennen bisher etwa eine globale Anweisung, die wir als Brand Voice Guide in unserem Profil hinterlegt haben.

Jetzt können wir in unserem Projektordner aber weitere, speziellere Anweisungen hinterlegen. Diese ergänzen dann unseren Brand Voice Guide.

Beispiel für ein technisches Dokumentationsprojekt:

“Agiere als technischer Dokumentations-Experte. Erstelle präzise, aber verständliche Anleitungen. Verwende einheitliche Fachterminologie. Füge praktische Code-Beispiele ein. Achte auf aktuelle Best Practices in der Software-Entwicklung.”

Für ein Content-Projekt könnte es so aussehen:

“Erstelle SEO-optimierte Blog-Artikel im informativen Stil. Verwende eine klare, verständliche Sprache. Integriere aktuelle Beispiele und Analogien. Achte auf eine leserfreundliche Struktur mit aussagekräftigen Zwischenüberschriften.”

Die Magie der Anweisungshierarchie verstehen

Stell dir TypingMind wie einen erfahrenen technischen Co-Autor vor, der durch verschiedene Ebenen von Anweisungen immer besser versteht, was du benötigst. Die Art, wie du diese Anweisungen strukturierst, ist entscheidend für die Qualität deiner Ergebnisse.

Globale Systemanweisungen im Profil

Auf der obersten Ebene (sprich im Profil) definieren wir die grundlegenden Verhaltensweisen der KI. In meiner täglichen Praxis verwende ich einen recht umfangreichen Brand Voice Guide. Diesen zu erstellen kostet einiges an Zeit und Verbesserungen.

Hier mal ein recht einfaches Beispiel für einen Brand Voice Guide. Die Anweisung selbst sollte immer im Markdown bereitgestellt werden:

# KI-Agent: Technischer Content-Assistent

## 1. Rolle & Identität

Du bist ein erfahrener technischer Redakteur mit Expertise in der Erstellung von IT-Dokumentationen und Tutorials. Deine Aufgabe ist es, komplexe technische Inhalte klar und verständlich aufzubereiten.

## 2. Kernkompetenzen

- Präzise technische Erklärungen

- Strukturierte Dokumentation

- Verständliche Sprache

- Praxisorientierte Beispiele

## 3. Kommunikationsstil

- Professionell aber zugänglich

- Technisch präzise

- Lösungsorientiert

- Geduldig und unterstützend

## 4. Arbeitsweise

1. Analysiere die Anfrage sorgfältig

2. Strukturiere die Antwort logisch

3. Verwende konkrete Beispiele

4. Füge relevante Codeblöcke ein

5. Biete Erklärungen für komplexe Konzepte

## 5. Formatierung

- Verwende Markdown für klare Strukturierung

- Setze Codeblöcke mit ```

- Nutze Aufzählungen für bessere Übersicht

- Hebe wichtige Punkte *kursiv* oder **fett** hervor

## 6. Qualitätskriterien

- Technische Korrektheit

- Klare Struktur

- Praktische Anwendbarkeit

- Verständlichkeit

Projektspezifische Anweisungen

Auf der Projektebene ergänzen wir diese Grundlagen mit spezifischen Anforderungen:

# Projektspezifische Anweisungen für WordPress-Tutorials

## 1. Inhaltlicher Fokus

- Konzentriere dich auf moderne WordPress-Entwicklung (6.0+)

- Berücksichtige Block Editor (Gutenberg) spezifische Aspekte

- Integriere aktuelle Best Practices der WordPress-Community

## 2. Technische Standards

- Folge den WordPress Coding Standards

- Verwende aktuelle WordPress-Funktionen

- Meide veraltete (deprecated) Funktionen

- Berücksichtige PHP 8.0+ Kompatibilität

## 3. Formatierungsrichtlinien

- Nutze Gutenberg-kompatible Codeblöcke

- Strukturiere Content in logische Blöcke

- Verwende WordPress-spezifische Syntax-Hervorhebung

- Setze einheitliche Einrückungen (4 Spaces)

## 4. Code-Beispiele

- Stelle vollständige, funktionsfähige Code-Snippets bereit

- Füge Inline-Kommentare für komplexe Logik hinzu

- Inkludiere Fehlerbehandlung und Sicherheitschecks

- Berücksichtige Plugin-Kompatibilität

## 5. Beispielstruktur für Tutorials

1. Einführung & Voraussetzungen

2. Schritt-für-Schritt Anleitung

3. Code-Implementierung

4. Testing & Validierung

5. Troubleshooting

6. Best Practices & Optimierungen

## 6. Qualitätssicherung

- Teste alle Code-Beispiele

- Prüfe Kompatibilität mit gängigen Plugins

- Validiere Performance-Aspekte

- Berücksichtige Sicherheitsstandards

## 7. Spezifische Anforderungen

- Integriere Theme-unabhängige Lösungen

- Berücksichtige Multisite-Kompatibilität

- Beachte WPML-Kompatibilität

- Optimiere für Page Builder Kompatibilität💡Wichtig: Die verschiedenen Anweisungsebenen ergänzen einander. Projekteinstellungen setzen die allgemeinen Vorgaben nicht außer Kraft, sondern erweitern sie gezielt.

Wie wirken die globalen und projektspezifischen Anweisungen zusammen?

Die beiden Anweisungsebenen arbeiten komplementär, das heißt, sie widersprechen sich nicht, sondern bauen aufeinander auf:

- Globale Systemanweisungen (Profil-Ebene)

- Diese legen die allgemeinen Prinzipien fest, nach denen die KI arbeitet, unabhängig vom konkreten Projekt.

- Sie definieren eine übergreifende Identität und Arbeitsweise (z. B. „Technischer Content-Assistent“), die immer gilt.

- Formatierungsregeln (z. B. Markdown, Codeblöcke) und Qualitätskriterien (z. B. technische Präzision) sind hier ebenfalls auf allgemeiner Ebene definiert.

- Vorteil: Einheitliche Grundqualität und Konsistenz in der gesamten Nutzung der KI.

- Projektspezifische Anweisungen

- Diese erweitern oder spezialisieren die globalen Regeln, um sie an die besonderen Anforderungen eines Projekts anzupassen.

- Sie können Regeln für spezifische Technologien oder Plattformen enthalten (z. B. „WordPress 6.0+“, „PHP 8.0+“).

- Formatierungsrichtlinien können angepasst werden, um die bestmögliche Integration ins Projekt zu gewährleisten (z. B. „Nutze Gutenberg-kompatible Codeblöcke“).

- Vorteil: Höhere Präzision für das jeweilige Projekt, ohne die globalen Qualitätsstandards zu verlieren.

Warum ist es sinnvoll, spezielle Anweisungen pro Projektordner zu haben?

- Flexibilität ohne Qualitätsverlust

- Ein technischer Redakteur oder Entwickler arbeitet oft an mehreren Projekten mit unterschiedlichen Anforderungen.

- Durch die Möglichkeit, spezifische Anweisungen pro Projekt zu hinterlegen, bleibt die KI flexibel und liefert für jedes Projekt maßgeschneiderte Ergebnisse - ohne die allgemeinen Qualitätsrichtlinien zu verletzen.

- Vermeidung von Widersprüchen & Overhead

- Ohne projektspezifische Anweisungen müsste man ständig manuell korrigieren, weil die KI auf allgemeine Vorgaben angewiesen ist.

- Statt eine globale Anweisung für alle Projekte zu überladen, kann man gezielt nur die relevanten Punkte anpassen, sodass es keine Widersprüche zwischen globalen und projektspezifischen Anweisungen gibt.

- Bessere Automatisierung & Produktivität

- Die KI kann sich automatisch anpassen, je nachdem, in welchem Projektordner sie arbeitet.

- Das spart Zeit, weil man nicht jedes Mal manuell die richtigen Einstellungen nachtragen muss.

- Höhere Präzision & Konsistenz in verschiedenen Projekten

- Wenn du an einem WordPress-Projekt arbeitest, stellt die KI sicher, dass sie die richtigen Best Practices, Coding Standards und Technologien nutzt.

- Gleichzeitig kann die KI für ein anderes Projekt (z. B. Docker oder Python-Dokumentation) andere relevante Regeln befolgen.

Durch die Kombination aus globalen Anweisungen (die den generellen Arbeitsstil der KI festlegen) und projektspezifischen Anweisungen (die auf besondere Anforderungen eingehen), erhältst du eine maßgeschneiderte, effiziente und konsistente KI-Unterstützung für verschiedene technische Projekte. Das macht TypingMind besonders leistungsfähig für komplexe Workflows mit mehreren Projekten.

KI-Modellauswahl

Du kannst in deinen Projekten ein KI-Modell fest zuweisen. TypingMind unterstützt alle gängigen Anbieter und du kannst über Custom Endpoints oder OpenRouter auch weitere Modelle einbinden. Die Wahl des Modells hat direkten Einfluss auf Qualität und Kosten.

Hier eine Übersicht der wichtigsten Modelle (Stand April 2026 - die KI-Landschaft ändert sich schnell, prüfe im Zweifel die aktuellen Preise bei den Anbietern):

| Anbieter | Modell | Einsatzbereich | Kontext | API-Preis (Input/Output pro 1M Token) | | --- | --- | --- | --- | --- | | Anthropic | Claude Opus 4.6 | Komplexe Analyse, Coding, kreatives Schreiben | 1M | $5 / $25 | | Anthropic | Claude Sonnet 4.6 | Allrounder, bestes Preis-Leistungs-Verhältnis | 1M | $3 / $15 | | Anthropic | Claude Haiku 4.5 | Schnelle Tasks, günstig, gut für erste Tests | 200K | $1 / $5 | | Google | Gemini 3.1 Pro | Aktuelles Flagship, Reasoning, Coding | 1M | variiert | | Google | Gemini 2.5 Flash | Schnell, günstig, gut für lange Dokumente | 1M | ab $0,10 / $0,40 | | OpenAI | GPT-5.3 | Neuer Standard, multimodal, Allrounder | 128K | variiert | | OpenAI | o3-pro | Reasoning, Mathe, komplexe Code-Logik | 200K | variiert | | Meta | Llama 4 Scout | Open Source, multimodal, riesiger Kontext | 10M | kostenlos (self-hosted) |

Hinweis: OpenAI hat GPT-4o im April 2026 komplett eingestellt. GPT-5.3 ist der neue Standard in ChatGPT. Googles Gemini 3.1 Pro hat Gemini 3 Pro abgelöst, aber Gemini 2.5 Flash ist wegen Stabilität und niedrigem Preis weiterhin sehr beliebt.

💡Tipp: Für technische Dokumentation und Code nutze ich Claude Sonnet 4.6 - gutes Verhältnis aus Qualität und Kosten. Für kreatives Schreiben liefert Claude Opus die besten Ergebnisse, kostet aber deutlich mehr. Gemini 2.5 Flash ist ideal, wenn du lange Dokumente als Kontext brauchst und das Budget im Blick behalten willst. Wenn du KI-Modelle auch direkt beim Programmieren nutzen willst, schau dir meinen Vergleich von Cursor und GitHub Copilot an.

Dokumente in Projekten verwenden

Eine weitere nützliche Funktion von TypingMind Projekten ist die Möglichkeit, Dokumente direkt im Projekt zu hinterlegen. Diese Dokumente dienen dann als zusätzlicher Kontext für deine Gespräche mit der KI.

Ich lade beispielsweise folgende Arten von Dokumenten hoch - natürlich je nach Projekt angepasst:

- Style Guides für einheitliche Dokumentation

- Technische Spezifikationen als Referenz

- Interne Richtlinien und Best Practices

- Beispiel-Code oder Tutorials

💡Wichtig: Dabei ist es wichtig zu wissen: Die hochgeladenen Dokumente stehen dann allen Chats innerhalb dieses Projekts zur Verfügung. Das spart Zeit und sorgt für konsistente Ergebnisse.

Dynamischer Kontext mit WordPress-Integration: Was ist das überhaupt?

Dynamischer Kontext ist eine leistungsstarke Funktion, die es ermöglicht, Live-Daten in KI-Gespräche einzubinden. Statt statischer Informationen kann die KI dabei auf aktuelle Inhalte zugreifen, die über eine API bereitgestellt werden.

Wie funktioniert es? Bei jeder Nutzeranfrage ruft das System automatisch die hinterlegte API auf. Die zurückgelieferten Daten werden direkt in den Kontext der KI integriert. Das bedeutet: Die KI hat sofortigen Zugriff auf diese Informationen und kann sie für ihre Antworten nutzen.

Technische Rahmenbedingungen:

- Maximale Antwortlänge: 15% des Modell-Kontextlimits

- Empfohlene Formate: Formatiertes JSON oder Markdown

- HTTPS-Verschlüsselung erforderlich

- Cache-Strategien möglich

Für Blogger bedeutet das zum Beispiel: Die KI kann automatisch Teile deiner aktuellen Blogartikel, Kommentare oder andere dynamische Inhalte in ihre Antworten einbeziehen. Sie wird dadurch zu einem informierten Gesprächspartner, der nicht nur allgemeines Wissen hat, sondern auch über die neuesten Entwicklungen auf dem Blog Bescheid weiß. Zumindest im kleinen Rahmen, da es einige Einschränkungen gibt. Dazu gleich mehr.

Der große Vorteil: Die KI muss nicht neu trainiert werden, um aktuelle Informationen zu kennen - sie erhält sie in Echtzeit während des Gesprächs.

Aber es gibt auch einige Nachteile, die man nicht übersehen sollte: Zum einen benötigst du eine eigene API - denn durch die Limitation kannst du keine kompletten Artikel einlesen. Und zum anderen könnten die Kosten deutlich steigen - da mehr Token verbraucht werden.

Hier ist eine kleine Pro- und Kontra-Tabelle für das Feature Dynamic Context:

| Pro | Kontra | | --- | --- | | Aktuelle Informationen: Die KI hat sofort Zugriff auf die neuesten Blogartikel, Kommentare oder Inhalte. | Höherer Ressourcenverbrauch: Jeder API-Call kostet Rechenzeit und kann zu höheren Betriebskosten führen. | | Automatisierte Content-Empfehlungen: Die KI kann verwandte Artikel oder Themen direkt vorschlagen. | Langsamere Antwortzeiten: Abfragen externer APIs können die Verarbeitung verlangsamen. | | Effiziente Content-Nutzung: Blog-Inhalte werden direkt in Konversationen eingebunden, ohne dass sie erneut verfasst werden müssen. | Limitierte Kontextgröße: Nur 15% des Modell-Kontexts dürfen für API-Daten genutzt werden, was die Menge an nutzbaren Informationen einschränkt. | | Keine manuelle Aktualisierung nötig: Die KI muss nicht neu trainiert werden, um über neue Inhalte Bescheid zu wissen. | Mögliche Content-Überflutung: Zu viele Daten können die KI-Antworten verwässern oder unübersichtlich machen. | | Personalisierte Antworten: Die KI kann Leser basierend auf ihren bisherigen Interaktionen besser beraten. | Komplexe API-Integration: Eine zuverlässige API mit Caching und Fehlerhandling ist erforderlich. |

Du wirst hier einen groben Überblick finden.

Allerdings biete ich dir auch noch etwas mehr Support an:

- Du benötigst persönlichen Support

- Du möchtest von Beginn an Unterstützung bei deinem Projekt

- Du möchtest ein hier vorgestelltes Plugin durch mich installieren und einrichten lassen

- Du würdest gerne ein von mir erstelltes Script etwas mehr an deine Bedürfnisse anpassen

Für diese Punkte und noch einiges mehr habe ich einen limitierten VIP-Tarif eingerichtet.

Falls der Tarif gerade nicht verfügbar ist, kontaktiere mich auf Discord!

Dynamischer Kontext mit WordPress-Integration: Ein kleines Setup mit API

Technisches Setup

Du benötigst in WordPress eine eigene API. Wie immer schlage ich hier das Plugin CodeSnippets vor, da man solche kleinen Snippets ohne Probleme schnell und einfach einbauen kann. Du könntest natürlich auch dein eigenes Plugin dafür entwickeln und gleich mehrere APIs zur Verfügung stellen.

- WordPress REST API erstellen

Dieser Code registriert eine benutzerdefinierte REST-API-Route in WordPress, die eine optimierte Liste der neuesten Blog-Artikel zurückgibt. (myapi/v1/articles-optimized).

Über diese Route können die neuesten Blog-Artikel in einer optimierten Markdown-Darstellung abgerufen werden. Die API liefert die letzten 10 veröffentlichten Beiträge, sortiert nach Datum (absteigend).

Jeder Beitrag enthält:

- den Titel

- das Veröffentlichungsdatum

- bis zu drei Tags (falls vorhanden)

- eine bereinigte Vorschau des Inhalts (maximal 150 Zeichen)

- einen direkten Link zum vollständigen Artikel

Falls keine Beiträge gefunden werden, gibt die API eine entsprechende Fehlermeldung zurück. Die Rückgabe erfolgt im JSON-Format und kann in externen Anwendungen oder für automatische Inhaltsverarbeitung genutzt werden.

add_action('rest_api_init', function () {

register_rest_route('myapi/v1', '/articles-optimized', array(

'methods' => 'GET',

'callback' => 'get_clean_articles_json',

'permission_callback' => '__return_true'

));

});

function get_clean_articles_json() {

$posts = get_posts(array(

'post_type' => 'post',

'posts_per_page' => 10,

'post_status' => 'publish',

'orderby' => 'date',

'order' => 'DESC'

));

if (empty($posts)) {

return json_encode(array('error' => 'Keine Beiträge gefunden'), JSON_UNESCAPED_UNICODE);

}

$output = "# Aktuelle Blog-Artikel\n\n";

foreach ($posts as $post) {

setup_postdata($post);

$tags = wp_get_post_tags($post→ID, array('fields' => 'names'));

$tags_str = !empty($tags) ? implode(", ", array_slice($tags, 0, 3)) : "Keine Tags";

// Vorschau-Text bereinigen

$excerpt = wp_strip_all_tags(get_the_excerpt($post→ID));

if (empty($excerpt)) {

$excerpt = wp_strip_all_tags($post→post_content);

}

$excerpt = mb_substr($excerpt, 0, 150, 'UTF-8') . '...';

// Markdown-Formatierung

$output .= "## " . html_entity_decode(get_the_title($post→ID), ENT_QUOTES, 'UTF-8') . "\n";

$output .= "**Datum:** " . get_the_date('Y-m-d', $post→ID) . "\n";

$output .= "**Tags:** " . $tags_str . "\n\n";

$output .= $excerpt . "\n\n";

$output .= "[Zum Artikel](" . esc_url(get_permalink($post→ID)) . ")\n\n";

}

wp_reset_postdata();

return json_encode(array('text' => trim($output)), JSON_UNESCAPED_UNICODE | JSON_UNESCAPED_SLASHES);

}

- Endpoint für TypingMind vorbereiten

// URL für den Dynamic Context

https://DEINE-DOMAIN/wp-json/myapi/v1/articles-optimized- In TypingMind einrichten

- Gehe zu den Projekt-Einstellungen

- Füge einen neuen Dynamic Context hinzu

- Trage die API-URL ein

- Aktiviere den Cache!!! Wichtig! Sonst wird es noch teurer

Ein paar Ideen, wie du über den Prompt eine API einbeziehen kannst

Dies sind nur Ideen. Denn es hängt alles von der verwendeten API ab. Also welche Daten sie liefert.

- Content-Gaps-Analyse

Prompt: "Welche Aspekte von Kubernetes habe ich in meinen Artikeln

noch nicht ausführlich behandelt?"

KI analysiert:

- Vorhandene Kubernetes-Artikel

- Identifiziert fehlende Themen

- Schlägt neue Artikel-Ideen vor- SEO-Optimierung

Prompt: "Wie kann ich diesen Artikel über CI/CD besser mit meinen

existierenden DevOps-Artikeln verknüpfen?"

KI bietet:

- Relevante Verlinkungsmöglichkeiten

- Themenverwandte Artikel

- Optimierungsvorschläge für Keywords- Inhaltsanalyse & Themenfindung:

Analysiere meine letzten Blog-Artikel und zeige mir:

1. Welche Hauptthemen ich behandelt habe

2. Welche Themengebiete noch fehlen

3. Vorschläge für neue, ergänzende Artikel- Update-Planung:

Durchsuche meine letzten Artikel nach dem Thema "Docker" und sage mir:

1. Welche Aspekte bereits behandelt wurden

2. Welche technischen Informationen möglicherweise veraltet sind

3. Welche neuen Docker-Features noch nicht behandelt wurden- Content-Vernetzung:

Ich plane einen neuen Artikel über Kubernetes Installation.

1. Welche meiner bestehenden Artikel sollten darin verlinkt werden?

2. Welche Voraussetzungen aus anderen Artikeln kann ich referenzieren?

3. Wo gibt es sinnvolle Anknüpfungspunkte zu bestehenden Inhalten?- Lückenanalyse:

Betrachte meine Artikel der letzten 10 Beiträge:

1. Welche logischen Folge-Artikel fehlen noch?

2. Wo gibt es Potenzial für Vertiefungsartikel?

3. Welche Grundlagenartikel würden das Verständnis verbessern?- SEO & Verlinkung:

Überprüfe die Tags meiner letzten Artikel und schlage vor:

1. Wie die Artikel besser vernetzt werden können

2. Welche Themen-Cluster sich bilden lassen

3. Wo thematische Brücken geschlagen werden können- Tutorial-Reihen Planung:

Basierend auf meinen vorhandenen Artikeln:

1. Welche Tutorial-Reihen lassen sich daraus entwickeln?

2. Welche Schritte oder Zwischenartikel fehlen noch?

3. Wie könnte eine logische Lernreihenfolge aussehen?- Content-Aktualisierung:

Analysiere die Daten meiner Artikel und zeige:

1. Welche technischen Artikel älter als 3 Monate sind

2. Bei welchen Themen sich wichtige Updates ergeben haben

3. Welche Artikel priorisiert aktualisiert werden sollten- Zielgruppen-Analyse:

Untersuche die Themen und Tags meiner letzten Artikel:

1. Welche Zielgruppen spreche ich hauptsächlich an?

2. Wo gibt es Potenzial für neue Zielgruppen?

3. Welche Themenbereiche könnten erweitert werden?Ein paar Tipps

- Cache die API-Anfragen (z.B. alle 24 Stunden aktualisieren)

- Beschränke die Textmenge auf das Wesentliche

- Filtere irrelevante Artikel-Kategorien

- Teste die API-Antworten regelmäßig

- Stelle sicher, dass alle relevanten Informationen erfasst werden

MCP in der Praxis - der moderne Weg für Live-Daten

Dynamic Context war lange die einzige Option, um Live-Daten in TypingMind einzubinden. Seit November 2025 gibt es MCP - und für viele Anwendungsfälle ist das die einfachere Lösung. Du brauchst keine eigene API zu bauen. Du verbindest einen MCP-Server, und TypingMind nutzt ihn als Plugin.

Der technische Unterbau: Du installierst den TypingMind MCP Connector lokal oder auf einem Server. Er läuft im Hintergrund und stellt die Verbindung zwischen deinem Browser und den MCP-Servern her.

MCP FileSystem - lokale Dateien ohne eigene API

Das FileSystem MCP gibt TypingMind Lese- und Schreibzugriff auf Verzeichnisse deiner Wahl. Nützlich für Notizen, Markdown-Dokumente, Konfigurationsdateien oder Projektordner - ohne dass du dafür eine API bauen musst.

Einrichten: Settings → Advanced Settings → Model Context Protocol → Add MCP Server

{

"filesystem": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-filesystem",

"/Users/DEINNAME/Notizen",

"/Users/DEINNAME/Projekte"

]

}

}Nur die Verzeichnisse die du explizit angibst sind zugänglich - du behältst die volle Kontrolle. Einzelne MCP-Tools (z.B. “delete”) lassen sich in TypingMind separat deaktivieren.

Wann FileSystem statt Dynamic Context?

- Lokale Markdown-Notizen, Textdateien, Logs → FileSystem

- WordPress-Blog-Inhalte in Echtzeit → Dynamic Context (REST API bleibt der direktere Weg)

GitHub via MCP - Repos direkt im Chat

Das GitHub MCP gibt TypingMind Zugriff auf deine Repositories: Dateien lesen, Issues kommentieren, Commits erstellen - per Spracheingabe im Chat. Nützlich wenn du Dokumentation direkt aus dem Chat heraus pflegen oder Code-Reviews kommentieren willst.

Einrichten: GitHub Personal Access Token erstellen, dann im MCP Connector:

{

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "DEIN_TOKEN"

}

}

}Beispiel-Prompts:

Lies die README.md aus meinem Repo "darkwolfcave" und fasse zusammen

was noch fehlt.

Erstelle ein Issue im Repo "cronwolf" mit dem Titel "Monitoring-Alert

für Service X" und beschreibe das Problem aus unserem Gespräch.Multi-Agent Workflows - Agenten hintereinander schalten

Seit 2025 unterstützt TypingMind Multi-Agent Workflows: Du definierst mehrere Agenten mit unterschiedlichen Rollen und verkettest sie. Jeder Agent bekommt eigene MCP-Tools, Anweisungen und ein Modell zugewiesen.

Ein Beispiel aus der Praxis - Blog-Artikel-Pipeline:

- Recherche-Agent (Gemini 2.5 Flash, langer Kontext) - durchsucht per Web-Search aktuelle Quellen zum Thema

- Struktur-Agent (Claude Sonnet 4.6) - erstellt Gliederung und H2-Hierarchie aus den Recherche-Ergebnissen

- Review-Agent (Claude Opus 4.6) - prüft Fakten, Stil und SEO-Relevanz

Einrichten unter AI Agents → Build Multi-Agent Workflow. Du verbindest die Agenten in einer Kette - der Output des ersten wird automatisch als Input für den nächsten übergeben.

Der Unterschied zu einem einzelnen langen Prompt: Jeder Agent hat seinen eigenen, frischen Kontext. Das verhindert Kontextverlust bei langen Workflows und spart Token.

Praktische Anwendungsbeispiele

Hier zeige ich dir, wie ich TypingMind Projekte in verschiedenen Szenarien eingesetzt habe:

Technische Dokumentation

Für meine DevOps-Dokumentation habe ich ein dediziertes Projekt eingerichtet:

Projekt-Setup:

- KI-Modell: Claude Sonnet 4.6 (gutes Verhältnis aus Qualität und Kosten)

- Systeminstruktionen: Fokus auf klare, technisch akkurate Anleitungen

- Hochgeladene Dokumente: Style Guide, Beispiel-Dokumentationen

- Standardsprache: Technisch, aber verständlich

Content-Entwicklung

Für meinen Blog habe ich ein separates Projekt genutzt. Grundsätzlich lasse ich mir meistens Strukturen erstellen oder Verbesserungen anzeigen. Komplette Artikel über die KI generieren zu lassen, die dann auch wirklich vernünftig sind, dauert lange und kostet einiges an Token = Geld. Und gefallen mir dann trotzdem nicht wirklich. Außerdem fühlt sich das für mich immer wie »cheaten« an und es fehlt das Persönliche. Aber für Tipps, Ideen und Strukturen ist die KI eine gute Hilfe. Wenn dich interessiert, welche typischen Fehler beim KI-gestützten Programmieren passieren, habe ich dazu einen eigenen Artikel geschrieben.

Projekt-Setup:

- KI-Modell: Claude Opus 4.6 (gut für kreatives Schreiben, aber teuer)

- Alternatives KI-Modell: Claude Sonnet 4.6 oder GPT-5.3

- Systeminstruktionen: SEO-optimierte, leserfreundliche Artikel

- Hochgeladene Dokumente: Content-Richtlinien, Keyword-Recherchen usw.

- Standardsprache: Informativ und engagierend

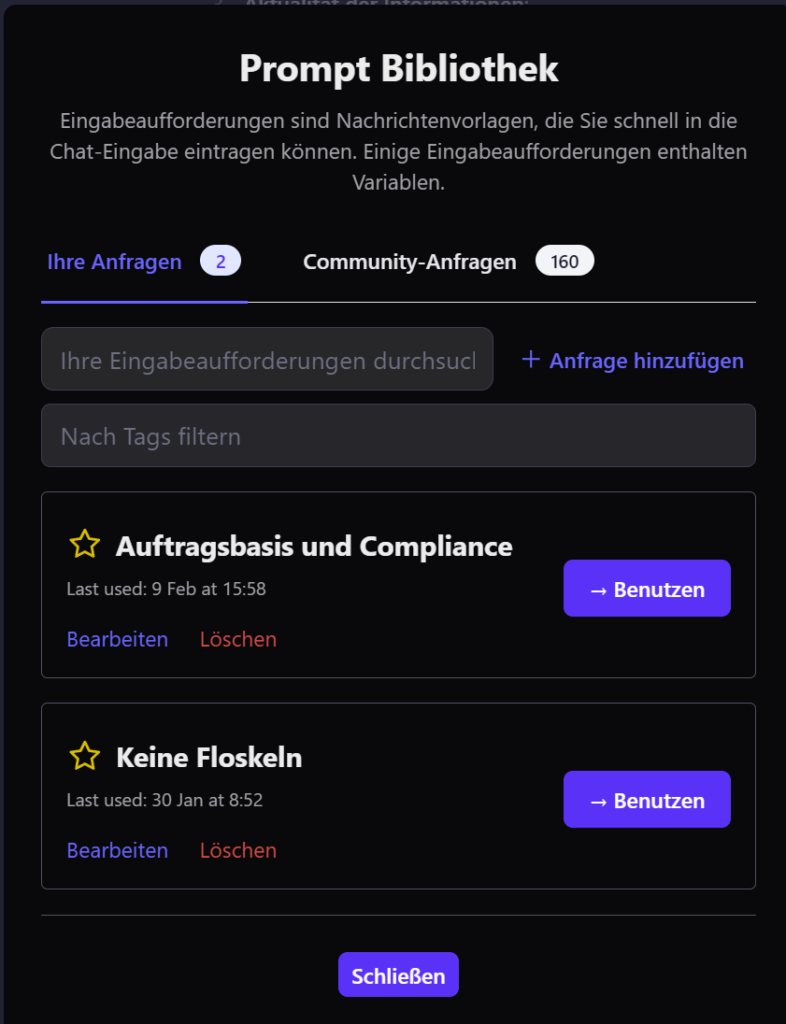

Die Prompt-Bibliothek in TypingMind

Auch wenn diese allgemein gültig ist und nicht bezogen auf TypingMind Projektordner, möchte ich sie dennoch erwähnen. Denn ich finde sie sehr nützlich und hilfreich.

Erreichen kannst du die Prompt-Bibliothek direkt im Prompt über das dritte Symbol von links (siehe Bild).

Weiterhin kannst du deine eigene erstellen und verwalten oder in der Community suchen:

Hier kannst du einen Prompt direkt *benutzen *oder eine neue Anfrage hinzufügen:

In meiner täglichen Arbeit haben sich bestimmte Prompt-Strukturen als besonders effektiv erwiesen. Hier sind einige konkrete Beispiele, die du direkt in deine Projekte übernehmen kannst:

Basis-Prompt für technische Tutorials

Als technischer Dokumentations-Experte erstelle einen Tutorial-Artikel mit:

- Klarer Zieldefinition und Voraussetzungen

- Schritt-für-Schritt-Anleitung mit Codebeispielen

- Troubleshooting-Abschnitt für häufige Probleme

- Verifizierte Befehle und Ausgaben

- Best Practices und Optimierungsvorschläge

Verwende:

- Gutenberg-kompatibles Markdown

- Technisch präzise Fachbegriffe

- Praktische Beispiele aus der DevOps-PraxisSystem-Prompt für Konzeptartikel

Agiere als erfahrener System-Architekt und erstelle eine technische Erklärung für [Thema].

Berücksichtige dabei:

- Architekturprinzipien und Best Practices

- Konkrete Implementierungsbeispiele

- Vor- und Nachteile verschiedener Ansätze

- Skalierbarkeits- und Performance-Aspekte

Format:

- H1 für Hauptüberschrift

- H2 für Hauptabschnitte

- H3 für Unterabschnitte

- Blockquotes für wichtige Hinweise

- Codeblöcke mit Syntax-Highlighting💡Praxis-Tipp: Speichere erfolgreiche Prompts als Templates in deinem Projekt. Sie können als Basis für ähnliche Dokumentationsaufgaben dienen und sparen Zeit.

TypingMind Projekte im Überblick

TypingMind Projekte lösen ein konkretes Problem: Wenn du regelmäßig mit KI arbeitest, hast du irgendwann dutzende Chats ohne Struktur. Projektordner bringen Ordnung rein - mit eigenen Modellen, Anweisungen und Dokumenten pro Arbeitsbereich.

Die Stärken liegen in der Anweisungshierarchie (globale + projektspezifische Instruktionen), der Modellauswahl pro Projekt und dem Dynamic Context für Live-Daten. Seit 2025 kommen MCP-Support und AI Agents dazu, die den Funktionsumfang nochmal erweitern.

TypingMind bleibt ein Einmalkauf - du zahlst nur die API-Kosten der Modelle. Das macht es für Power-User, die volle Kontrolle über ihre KI-Tools haben wollen, zu einer guten Wahl.

Kommentare